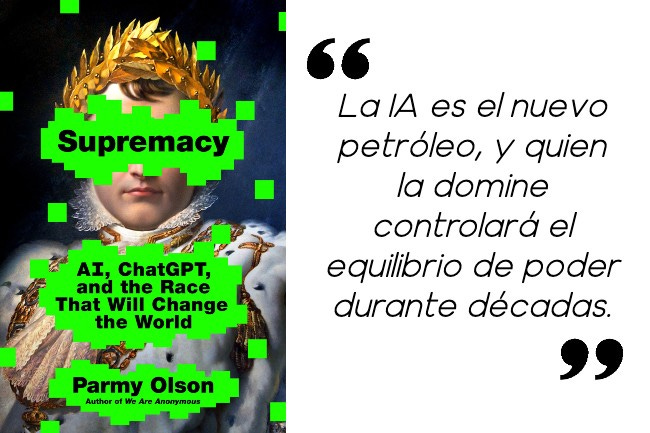

Supremacy de Parmy Olson

IA, ChatGPT y la carrera que cambiará el mundo

Hay carreras que se corren en estadios llenos de gritos y aplausos. Y luego están esas otras, las que transcurren en salas de juntas, centros de datos y despachos corporativos, donde el ruido es apenas el zumbido de los servidores y el teclear de algoritmos que reescriben las reglas del mundo. Parmy Olson, en su libro Supremacy: AI, ChatGPT, and the Race That Will Change the World, nos cuenta sobre la carrera por la supremacía en inteligencia artificial. Una competición que, mientras nosotros discutíamos si ChatGPT escribía bien o mal, ya había coronado a sus ganadores.

Dos visiones, un solo destino

La historia que nos presenta Olson es, en esencia, un duelo de titanes con personalidades aparentemente opuestas. Por un lado, Sam Altman, el carismático CEO de OpenAI, forjado en el ecosistema despiadado de Silicon Valley, donde las startups nacen y mueren como moscas de verano. Por el otro, Demis Hassabis, el cerebro detrás de DeepMind, con su formación en neurociencia y videojuegos, aparentemente más pausado, más científico, más reflexivo.

Pero fijaros como son las cosas:

"Hassabis creía que debía ser la ciencia, y no la velocidad, quien guiara el desarrollo de la IA. Pero el mundo se movía más rápido de lo que él deseaba."

Al final, ambos terminaron navegando las mismas aguas, cediendo parte de sus ideales originales a medida que las fuerzas del mercado y la presión competitiva los empujaban hacia el mismo puerto.

Es como ver a dos alpinistas que toman rutas diferentes para escalar la misma montaña, solo para descubrir al llegar a la cima que el paisaje se ve exactamente igual desde arriba, y que la montaña, en realidad, pertenece a los mismos dueños.

El espejismo de la apertura

OpenAI comenzó con una promesa que sonaba casi utópica: desarrollar inteligencia artificial general de manera abierta, democrática, al servicio de toda la humanidad. El nombre mismo era una declaración de intenciones. Pero como nos recuerda Olson:

"OpenAI comenzó con una promesa de apertura. Pero en la carrera por la supremacía, esa promesa se convirtió en un recuerdo."

La transformación de OpenAI de laboratorio sin ánimo de lucro a híbrido comercial aliado con Microsoft no fue un accidente. Fue el resultado inevitable de una ecuación simple: desarrollar IA de vanguardia requiere recursos que solo las grandes corporaciones pueden proporcionar. Y cuando Microsoft pone sobre la mesa miles de millones de dólares, las promesas ideológicas se vuelven... digamos, más flexibles.

Este cambio ilustra una de las paradojas más crueles de nuestro tiempo: las herramientas más poderosas para hacer más accesible el conocimiento terminan concentrando el poder en las mismas manos que siempre lo han tenido. Es como si hubiéramos inventado la imprenta solo para que Gutenberg decidiera que solo él podía usarla.

La nueva aristocracia digital

Mientras seguimos debatiendo sobre si la IA nos va a quitar el trabajo o si va a resolver el cambio climático, la realidad es que ya hemos permitido que se consolide una nueva forma de aristocracia. Una aristocracia que no se basa en la sangre azul o en la tierra heredada, sino en el control de los datos, los algoritmos y la infraestructura computacional.

"Las grandes tecnológicas tienen hoy más influencia sobre el futuro de la inteligencia artificial que la mayoría de los gobiernos."

Esta frase de Olson no es una exageración retórica, es una descripción literal de nuestro presente. Google, Microsoft, y unas pocas empresas más no solo deciden qué productos usamos, sino que definen los parámetros fundamentales de cómo la IA va a funcionar en nuestras vidas.

Y aquí, creo yo, está el principal problema:

"Las personas que decidían cómo la IA moldearía la sociedad no eran electas, no rendían cuentas y no representaban al público."

Hemos entregado las llaves del futuro a un puñado de ejecutivos cuya única responsabilidad real es con sus accionistas, no con nosotros. Bueno, más bien, nos han vendido un futuro empaquetado y lo hemos comprado con los ojos cerrados. Algo así como comprar un piso sobre plano.

El teatro de la ética corporativa

Uno de las cosas que más me inquietan y que documenta Olson es cómo la ética se ha convertido en poco más que un ejercicio de relaciones públicas. Las grandes tecnológicas contratan equipos de ética, publican principios rimbombantes sobre el uso responsable de la IA, y organizan conferencias donde hablan del futuro de la humanidad. Pero cuando llega el momento de la verdad, cuando hay que elegir entre los principios y los beneficios, la balanza siempre se inclina hacia el mismo lado.

"Cada principio ético era negociable frente a una oportunidad comercial."

Esta observación captura la esencia del problema: no es que estas empresas sean inherentemente malvadas, es que están operando dentro de un sistema que premia la rentabilidad por encima de todo lo demás. Y en ese sistema, la ética es un lujo que te puedes permitir solo cuando no interfiere con el negocio.

Los sesgos algorítmicos son un ejemplo perfecto de esto.

"Los modelos de IA no alucinan al azar: lo hacen dentro de los límites de sus datos de entrenamiento, que están sesgados por diseño."

Los problemas de discriminación racial, de género y cultural en los sistemas de IA no son bugs que se puedan arreglar con una actualización. Son features inherentes a modelos entrenados con datos que reflejan las desigualdades de nuestra sociedad.

La metamorfosis de los idealistas

Quizás lo menos sorprendente de esta historia es cómo los protagonistas han evolucionado. Sam Altman, que comenzó como un emprendedor con visión transformadora, ahora se mueve por los pasillos del poder como un político veterano.

"Altman no solo dirigía una empresa; se estaba posicionando como el guardián del futuro de la humanidad."

Pero ser el guardián del futuro de la humanidad, aparentemente, requiere negociar con fondos soberanos, hacer alianzas con gigantes tecnológicos y tomar decisiones que afectan a millones de personas sin consultarlas.

Hassabis, por su parte, mantiene su narrativa científica, pero ha cedido autonomía frente a la presión de Google por comercializar modelos. La ciencia pura es un lujo que Google no se puede permitir cuando Microsoft resopla en su cuello.

El nuevo petróleo

"La IA es el nuevo petróleo, y quien la domine controlará el equilibrio de poder durante décadas."

Esta comparación de Olson es especialmente nos recuerda que ya hemos vivido esto antes. La historia del petróleo en el siglo XX es la historia de cómo un recurso revolucionario terminó concentrado en manos de unas pocas compañías que redefinieron la geopolítica mundial.

Pero hay una diferencia crucial: el petróleo se puede encontrar, extraer y refinar en diferentes lugares del mundo. La IA de vanguardia, en cambio, requiere una combinación específica de talento, datos, capital y infraestructura que solo existe en unos pocos ecosistemas. Es un monopolio muy difícil de romper, incluso más que los acuerdos entre los países que controlan el petróleo.

La carrera del miedo

Una de las dinámicas más destructivas que describe Olson es cómo el miedo se ha convertido en el principal motor de innovación.

"Las empresas se apresuraban a integrar la IA no porque tuviera sentido, sino por miedo a quedarse atrás."

Este pánico colectivo ha creado un efecto dominó donde las decisiones se toman basándose en la percepción de riesgo competitivo, no en una evaluación racional de beneficios y costos.

El resultado es un mundo donde implementamos IA en educación, salud, justicia y servicios públicos sin haber resuelto primero los problemas fundamentales de sesgo, transparencia y rendición de cuentas. Es como si hubiéramos decidido construir centrales nucleares antes de inventar las medidas de seguridad, simplemente porque nuestros vecinos también estaban construyendo las suyas.

La nueva brecha digital

Si pensábamos que la brecha digital era un problema serio cuando se trataba de acceso a internet, Olson nos muestra que no habíamos visto nada aún.

"Quienes no tuvieran acceso a herramientas de IA quedarían aún más rezagados en educación, empleo e influencia."

La IA no es solo otra herramienta; es un multiplicador de capacidades humanas. Y cuando los multiplicadores se distribuyen de manera desigual, las desigualdades no crecen aritméticamente, sino exponencialmente.

Estamos creando un mundo de dos velocidades: aquellos con acceso a IA avanzada que pueden potenciar sus capacidades creativas, analíticas y productivas, y aquellos sin acceso que quedan condenados a competir con versiones aumentadas de sus pares. Es como una carrera donde algunos corredores tienen zapatillas deportivas de última generación y otros van descalzos.

La urgencia de lo inevitable

Necesitamos aceptar una verdad incómoda, que el modelo de desarrollo actual de la IA está guiado por incentivos empresariales, no por el bien público. Y que cambiar eso va a requerir algo más que regulaciones reactivas o comités de ética corporativa.

Va a requerir que decidamos, como sociedad, si estamos dispuestos a desafiar el poder de quienes ya han ganado la carrera. Porque al final, la pregunta no es si la IA va a cambiar el mundo. La pregunta es quién va a decidir cómo lo cambia.

Y por ahora, esa decisión está en manos de muy pocas personas. Personas que, como nos recuerda Olson, no fueron elegidas por nosotros, no nos rinden cuentas, y no necesariamente comparten nuestros intereses.

Altman com va dir en Groucho Marx ...

«Aquests són els meus principis. Si no li agraden, en tinc d'altres»