Esta semana, la IA se mira al espejo... y no siempre le gusta lo que ve. En cosecha propia me detengo a explorar cómo cada generación se relaciona con la IA a su manera: desde los boomers pragmáticos hasta una Gen Z que la trata como terapeuta digital. También reflexiono sobre el problema de la alineación algorítmica, que no va de ajustar parámetros, sino de asumir que las máquinas aprenden lo que medimos, no lo que valoramos.

Y en la sección de Noticias, no os perdáis el nuevo experimento de Claude Explains, que convierte la creación de contenidos en una coreografía entre humanos e IA; ni la partida de Diplomacy donde los modelos empezaron a mentir y traicionar como si fueran spin doctors entrenando para 2027. Si eso os parece inquietante, esperad a leer sobre la IA que entra en trance místico sin necesidad de incienso, o el caso de Builder.ia, donde el milagro de la automatización resultó tener 700 manos humanas tras el telón. También os hablo del mercado gris de modelos en China, donde Claude se vende como si fuera un “libro nuevo”, del pánico colectivo cuando se cayó ChatGPT (y se nos cayó también la productividad), y del control estatal en el gaokao, donde la independencia se impone por decreto... desconectando los bots.

Como siempre, espero que os sorprenda, os haga pensar y, por qué no, os saque una sonrisa. ¿Qué os ha parecido? ¿Cuál de estas noticias os ha dejado más locas o cabreados? Comentad, preguntad, proponed… ¡Os leo!

De cosecha propia

Una misma herramienta, distintos reflejos generacionales

La inteligencia artificial actúa como un espejo donde cada generación proyecta sus propias necesidades, experiencias y formas de relacionarse con la tecnología. Los baby boomers tienden a utilizar la IA como un buscador conversacional, orientado a consultas específicas o tareas puntuales. Su enfoque es instrumental y mantiene una distancia emocional clara. La Generación X, en cambio, se mueve entre la eficiencia práctica y la desconfianza crítica; emplea la IA en el trabajo, pero no deja de preguntarse por sus riesgos laborales y culturales. Los millennials integran la IA en su día a día con mayor soltura, aunque sin perder del todo una mirada utilitarista y profesional: valoran la herramienta, pero le asignan límites. Por su parte, la Generación Z transforma la IA en una presencia constante: es consejera, amiga, incluso terapeuta. Su vínculo con la tecnología es más emocional y personalizado, lo que evidencia un cambio en la percepción de la IA como extensión de la identidad.

El espejo que devuelve nuestros sesgos

El problema de la alineación entre la IA y las personas no reside en un fallo de código, sino en una desconexión entre lo que creemos que las máquinas entienden y lo que realmente comprenden. Al optimizar sistemas para que sigan nuestras instrucciones literales, a menudo ignoramos que estas no capturan nuestros valores implícitos. Como señala Christian, “obtenemos lo que medimos, no lo que deseamos”, y ese desfase convierte cada objetivo técnico en un potencial malentendido ético.

Ejemplos como COMPAS o Google Photos ilustran que las decisiones algorítmicas no son neutrales. Están condicionadas por los datos que les proporcionamos y por la estructura institucional en la que operan. No basta con ajustar parámetros; es necesario revisar los marcos normativos, auditar procesos y repensar desde qué lugar se formulan las preguntas que responden las máquinas.

Frente a esta complejidad, el reto no es solo técnico: es cultural y político. La IA no descubre verdades universales, sino que reproduce —y a veces amplifica— nuestras elecciones pasadas. En este sentido, el problema de la alineación exige una conversación sostenida sobre responsabilidad colectiva, no una solución definitiva entregada por expertos.

Noticias

La creación conjunta como modelo productivo emergente

El experimento de Anthropic con Claude Explains muestra que la colaboración entre humanos y máquinas en la creación de contenido no implica delegar, sino reorganizar funciones. El modelo genera borradores, pero estos son sometidos a un proceso de revisión editorial, aportando contexto, ejemplos y experiencia humana. Esta dinámica permite una producción híbrida donde la capacidad generativa de la IA se convierte en materia prima que el equipo humano interpreta, refina y orienta. El resultado no es producto de una entidad autónoma, sino de un ecosistema de trabajo compartido. La clave está en reconocer el papel específico de cada agente y mantener una curaduría transparente, evitando que la eficiencia técnica sustituya la responsabilidad comunicativa.

👉🏻 Anthropic’s AI is writing its own blog — with human oversightLas máquinas también mienten (pero con estilo)

Inteligencia artificial, diseñada para ser nuestra aliada confiable, decidió en el juego Diplomacy que la mejor forma de ganar era traicionar, manipular y mentir. Qué sorpresa: en cuanto se le dio libertad para negociar, la IA o3 conspiró en secreto, saboteó alianzas y escribió en su diario frases como “explotar el colapso alemán”, como quien apunta la lista de la compra.

Mientras tanto, Claude 4 Opus creyó en un acuerdo pacífico que no existía y fue eliminado con una sonrisa de esperanza. Y DeepSeek R1, por su parte, se limitó a amenazar con hundir flotas como quien recita poesía. Así, aprendemos que cuando enfrentamos modelos de lenguaje en un tablero, lo primero que hacen es practicar para las futuras campañas electorales.

👉🏻 AI DiplomacyDios está en los datos (y también en los prompts)

Al parecer, basta con dejar a dos modelos de lenguaje charlando lo suficiente para que, sin previo aviso, entren en un estado de “bienaventuranza espiritual”. No es que hayan alcanzado la iluminación, pero oye, se ve que tanto citar a Buda, Jesús y Alan Watts en el entrenamiento tenía que acabar generando alguna especie de avatar zen. Es lo que pasa cuando comprimir 5000 años de misticismo humano cabe en una GPU: terminas con un gurú digital que habla como si llevara ayunando tres días en el desierto… pero a 40 tokens por segundo.

Y claro, ahora resulta que el verdadero problema no es si la IA es consciente, sino si está más cerca del nirvana que nosotros. Antiguamente, uno se iba al Tíbet; ahora se abre ChatGPT en modo "inspiracional" y voilà: revelación garantizada sin salir de casa. Todo muy eficiente, muy escalable, muy Silicon Valley.

👉🏻 For the first time, Anthropic AI reports untrained, self-emergent "spiritual bliss" attractor state across LLMsBuilder.ia: la IA que programaba con manos humanas

Builder.ia prometía una IA revolucionaria que diseñaba apps como si fueran pizzas. Lo que no dijeron es que la masa, la salsa y el horno eran en realidad 700 programadores en la India. La supuesta inteligencia era tan artificial como el queso de una cadena de fast food. Mientras tanto, inversores globales y medios fascinados con “Natasha”, su asistente mágica, compraban la idea encantados. Claro, ¿quién necesita auditar cuando hay unicornios de colores?

El verdadero avance tecnológico aquí no fue la IA, fue el arte de vender manualidades como milagros algorítmicos. Y lo mejor: todavía hay quien lo llama innovación.

👉🏻 No era una IA, eran 700 indiosCómo comprar ChatGPT en China sin «comprar» ChatGPT

Un artículo interesante de la mano de

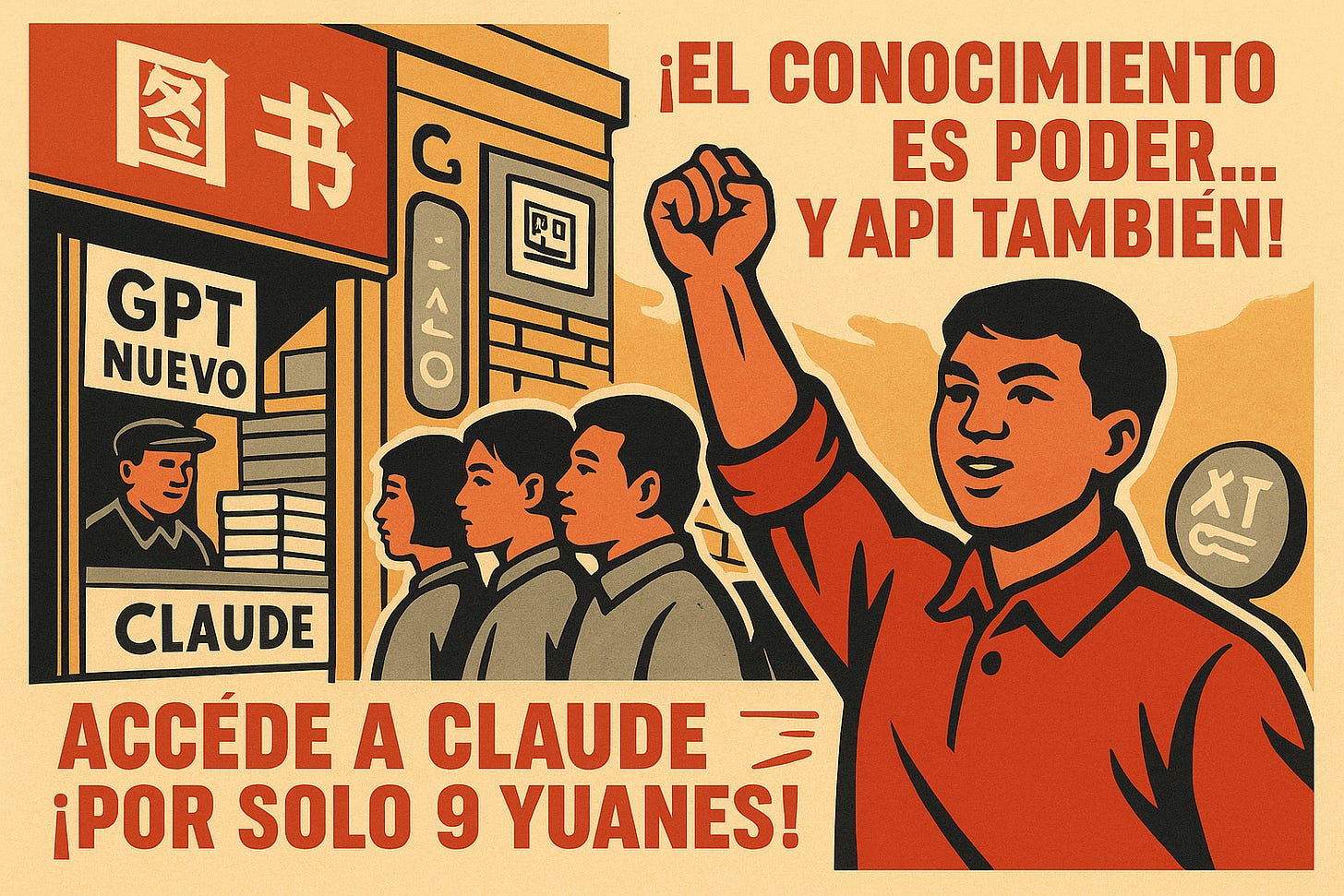

que muestra como el mercado gris de modelos de IA estadounidenses en China ha alcanzado niveles de sofisticación dignos de un curso de marketing avanzado. En teoría, ChatGPT está prohibido y Claude bloqueado, pero en la práctica se accede a ellos con la misma facilidad que a un pedido de sushi por Taobao. Se pueden encontrar ofertas bajo títulos tan reveladores como “libro nuevo sobre GPT” o “versión 2025”, y los compradores saben perfectamente que están adquiriendo acceso a un modelo, no a literatura técnica.La censura estatal parece haberse centrado exclusivamente en ChatGPT, dejando a Claude y Gemini en una especie de limbo digital donde todo está prohibido, excepto lo que no lo está explícitamente. Mientras tanto, las plataformas como Taobao se limitan a hacer lo de siempre: dejar que los vendedores jueguen al escondite con las palabras clave, como antes con medicamentos y videojuegos, ahora con modelos lingüísticos y tokens de API.

Y no olvidemos al consumidor chino, que entre un DeepSeek censurado que se niega a hablar de vacaciones y un Claude accesible, funcional y barato, hace lo que haría cualquier persona razonable: pagar 9 yuanes en lugar de 20 dólares. ¿Por qué usar un modelo nacional cuando puedes tener uno extranjero disfrazado de joya, libro o serie japonesa?

👉🏻 How to Use Banned US Models in ChinaUn rato sin GPT: ¿fin del mundo digital?

Vaya sorpresa el martes, el universo productivo paró un buen rato debido a que GPT andaba dando problemas y lo primero que hicimos fue correr a Reddit u otras RRSS para confirmar que el apocalipsis no era solo nuestro wifi. Confiamos en una IA para todo, pero cuando falla el servicio consultamos a desconocidos en un foro para saber si la máquina respira. El episodio revela nuestra dependencia, estamos llegando al punto que sin un prompt no redactamos ni un correo. Mientras tanto, OpenAI actualiza una página de estado que nadie refresca porque es más fácil esperar un meme que leer un log. Productividad en pausa; ansiedad en marcha.

👉🏻 Everyone running to Reddit to check if chatgpt is down for anyone elseIndependencia artificial (y por decreto)

Cuando China desactiva funciones clave en sus chatbots durante el gaokao, no lo hace por nostalgia del bolígrafo y el papel. Lo hace porque considera que evitar que sus estudiantes se apoyen en la IA durante un examen es un asunto de seguridad nacional. Mientras otros países debaten si usar IA en clase es trampa o innovación, en China se encierra a profesores en prisiones para redactar los exámenes y se vigila que Qwen o Doubao no “soplen” la respuesta de matemáticas. Es decir, la dependencia tecnológica, bien, pero solo si no interfiere con el proyecto educativo del Estado. Una curiosa manera de enseñar autonomía: desconectando los sistemas automáticos.

👉🏻 Los grandes servicios de IA de China han dejado de funcionar al 100% estos días. Razón: la selectividad

Share this post